Ich erinnere mich noch gut an die Zeit, als SEOs riesige Excel-Tabellen für ihre Link-Kampagnen pflegten. Jede Zeile eine URL, jede Spalte eine Anweisung für den exakten Ankertext: ‚Turnschuhe günstig kaufen‘, ‚bester Steuerberater Berlin‘. Wir dachten, wir wären clever. Wir glaubten, Google genau das Signal zu geben, das es braucht.

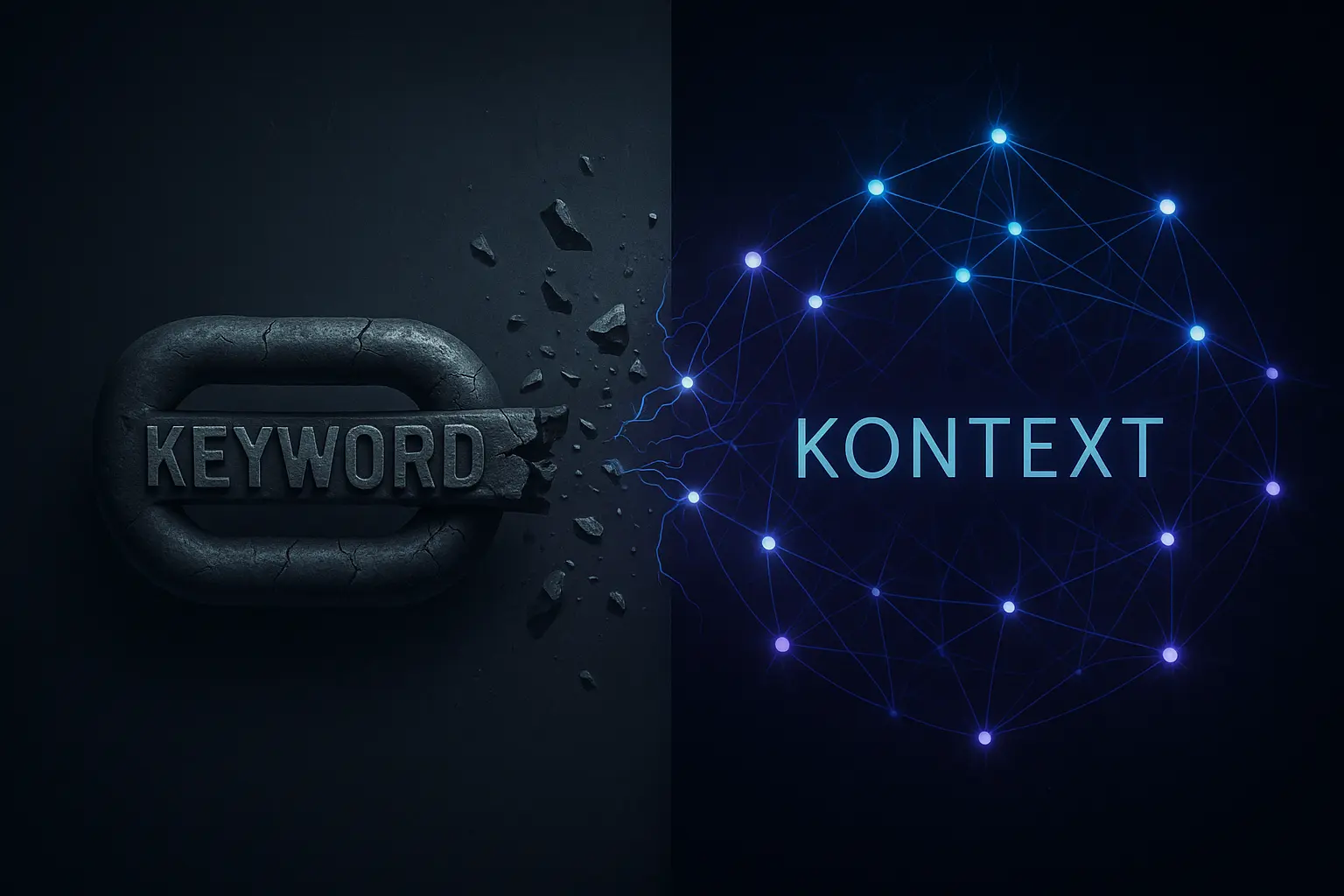

Heute weiß ich: Wir haben die Maschinen und ihre Entwicklung komplett missverstanden. Wir haben versucht, ihnen eine Sprache beizubringen, die sie längst nicht mehr sprechen. Die Jagd nach dem perfekten Keyword-Ankertext ist nicht nur veraltet, sie ist aktiv schädlich. Denn moderne KI-Systeme lesen keine Keywords. Sie verstehen Beziehungen. Und diese Beziehungen entstehen nicht im Link selbst, sondern im Text, der ihn umgibt.

Das alte Spiel: Ein Link als reines Keyword-Signal

Früher war die SEO-Welt einfacher. Suchmaschinen waren damals im Kern riesige Index-Systeme, die auf simple Signale angewiesen waren. Ein Link mit dem Ankertext ‚rote Schuhe‘ zu einer Seite über rote Schuhe war ein klares, unmissverständliches Signal. Je mehr solcher Links, desto relevanter musste die Seite für ‚rote Schuhe‘ sein.

Diese Logik führte zu einer ganzen Industrie der Ankertext-Optimierung. Es ging darum, ein möglichst ’natürliches‘ Ankertext-Profil aufzubauen: ein Mix aus exakten Keywords, Markennamen und generischen Begriffen wie ‚hier klicken‘. Das Ziel war, Relevanz vorzutäuschen, ohne von Algorithmen wie dem Google Penguin abgestraft zu werden.

Dieses Denken ist ein Relikt aus einer Zeit, in der Maschinen versuchten, menschliche Sprache durch das Zählen von Wörtern zu verstehen. Doch diese Zeit ist endgültig vorbei.

Der Wandel: Wie Maschinen lernten, Kontext zu lesen

Die Evolution der Suchmaschinen ist die Geschichte eines immer besseren Textverständnisses. Mehrere Meilensteine haben fundamental verändert, wie Links bewertet werden:

-

Die Idee des ‚Reasonable Surfer‘ (ca. 2004): Schon früh erkannte Google, dass nicht alle Links gleich sind. Das ‚Reasonable Surfer Model‘ basierte auf der Idee, dass Links, die prominenter platziert und wahrscheinlicher geklickt werden, mehr Gewicht haben. Ein versteckter Link im Footer ist weniger wert als ein Link im ersten Absatz eines relevanten Artikels. Das war der erste Hinweis darauf, dass das Umfeld eines Links eine entscheidende Rolle spielt.

-

Phrase-Based Indexing (ca. 2005): Statt einzelner Keywords begann Google, ganze Phrasen zu analysieren. Der Zusammenhang von Wörtern rückte in den Fokus. ‚Wie man einen Kuchen backt‘ wurde als eine zusammenhängende Idee verstanden, nicht als die losen Wörter ‚wie‘, ‚man‘, ‚einen‘, ‚Kuchen‘ und ‚backt‘.

-

BERT und die Revolution des Kontexts (2018): Das war der eigentliche Wendepunkt. BERT (Bidirectional Encoder Representations from Transformers) ermöglichte es Google, die Bedeutung eines Wortes anhand der Begriffe zu verstehen, die davor und danach stehen. BERT liest einen Satz in beide Richtungen, um den vollen Kontext zu erfassen.

Für Links bedeutet das: Die Maschine schaut nicht mehr isoliert auf den Ankertext ‚unser Guide‘. Sie liest den ganzen Satz: ‚Um die komplexen Zusammenhänge von Datenstrukturen zu verstehen, ist unser Guide eine unverzichtbare Ressource, die alles Schritt für Schritt erklärt.‘ Plötzlich weiß die KI, dass der verlinkte Guide eine erklärende, tiefgehende Ressource zum Thema Datenstrukturen ist. Der Ankertext allein hätte das niemals verraten.

Kontext-Design statt Ankertext-Optimierung

Wenn du das verstanden hast, ändert sich dein gesamter Ansatz für die Verlinkung. Du hörst auf, Ankertexte zu ‚optimieren‘, und fängst an, ‚Kontext zu designen‘. Ein starker kontextueller Link besteht aus drei Elementen:

-

Der vorbereitende Satz: Er führt ein Problem, eine Frage oder eine These ein und schafft so den thematischen Rahmen für die Information, die gleich folgt.

Beispiel: ‚Viele Marketer kämpfen damit, ihre Marke als klares Konzept für Maschinen verständlich zu machen.‘

-

Der Satz mit dem Link: Er positioniert den Link als logische Lösung, Antwort oder Vertiefung zum zuvor genannten Problem. Der Ankertext darf dabei ganz natürlich sein.

Beispiel: ‚Unser Framework zeigt, wie man eine Marke als Entität modelliert und ihre Beziehungen im Knowledge Graph definiert.‘

-

Der bestätigende Satz: Er greift den Wert des Links auf oder führt den Gedanken weiter und zementiert so die thematische Verbindung.

Beispiel: ‚Dieser strukturierte Ansatz ist die Grundlage für jede erfolgreiche KI-Sichtbarkeitsstrategie.‘

Dieser Dreiklang sendet ein unglaublich starkes Signal. Er sagt der Maschine nicht nur, worüber die verlinkte Seite handelt, sondern auch, welche Funktion sie erfüllt (z. B. als Lösung, Definition oder Beweis). Du baust damit ein logisches Netz aus Informationen auf, das Maschinen lesen und verstehen können. Jeder Link stärkt so deine thematische Autorität im gesamten Themencluster.

Warum das für KI-Antworten entscheidend ist

Diese Entwicklung wird durch den Aufstieg von KI-Systemen wie ChatGPT, Perplexity oder Gemini noch beschleunigt. Wenn diese Modelle eine Antwort generieren und eine Quelle zitieren, tun sie das nicht wegen eines optimierten Ankertextes. Sie tun es, weil der Kontext um den Link herum exakt die Behauptung in der KI-Antwort stützt.

Die KI versteht: Der Satz ‚In einer Studie von 2023 wurde nachgewiesen, dass X zu Y führt‘, gefolgt von einem Link, belegt genau diese Aussage. So werden deine Inhalte nicht nur für klassische Suchmaschinen, sondern auch für KI-Systeme sichtbar und als zitierfähige Quelle eingestuft. Ein mit Keywords überladener Ankertext wirkt hier wie Spam – er unterbricht den logischen Fluss und schwächt die Glaubwürdigkeit.

FAQ: Häufige Fragen zur kontextuellen Verlinkung

Was ist ein Ankertext?

Der Ankertext ist der sichtbare, klickbare Teil eines Hyperlinks. Früher wurde er gezielt mit Keywords optimiert; heute besteht seine wichtigste Aufgabe darin, sich natürlich in den umgebenden Text einzufügen.

Ist jeder Keyword-Ankertext schlecht?

Nein, nicht per se. Wenn das Keyword natürlich in den Satz passt, ist es vollkommen in Ordnung. Ein Satz wie ‚Mehr dazu erfährst du in unserem Guide über semantische Architektur‘ ist unproblematisch. Schädlich wird es, wenn Sätze unnatürlich um Keywords herum konstruiert werden (‚Hier klicken für die beste semantische Architektur und die besten Tipps.‘) oder wenn diese Art von Link systematisch und inflationär eingesetzt wird.

Wie lang sollte der Kontext um einen Link sein?

Es gibt keine exakte Zeichenzahl. Als Faustregel gilt jedoch: Der Satz vor dem Link leitet das Thema ein und der Satz mit dem Link trifft eine klare Aussage. Diese Kombination genügt oft schon, um einen starken Kontext zu schaffen.

Gilt das auch für externe Links?

Ja, absolut. Wenn du auf eine externe Quelle verlinkst, signalisierst du den Maschinen, welche Inhalte du für autoritativ und vertrauenswürdig hältst. Der umgebende Kontext erklärt der KI, warum du dieser Quelle vertraust und in welchem thematischen Zusammenhang sie zu deinem eigenen Inhalt steht.

Fazit: Baue Beziehungen, keine Link-Listen

Hör auf, Links zu ‚optimieren‘. Fang an, thematische Beziehungen zwischen Inhalten zu gestalten. Jeder Link ist eine Chance, den Maschinen zu erklären, wie deine Inhalte zusammenhängen und welches Problem sie für den Nutzer lösen.

In der Ära der KI-Systeme gewinnt nicht der beste Ankertext, sondern der klarste Kontext. Er ist die Sprache, die Maschinen wirklich verstehen, und die Grundlage für echte, dauerhafte Sichtbarkeit.