Ich saß vor dem Analyse-Dashboard und verstand die Welt nicht mehr. Ein Top-Produkt, brillante Bilder, der Text perfekt auf die Zielgruppe abgestimmt. Trotzdem tauchte es in den neuen, KI-gestützten Empfehlungs-Feeds unter völlig falschen Begriffen auf. Die Klicks blieben aus. Der Grund war so banal wie fatal: Wir hatten der KI unbewusst widersprüchliche Signale geliefert. Das Bild sagte „roter Apfel“, der Alt-Text flüsterte „süße Banane“.

Dieses Erlebnis war mein Weckruf. Wir optimieren immer noch für eine Welt, in der Text König war. Doch die neuen Gatekeeper – Google, ChatGPT, Perplexity – sind multimodal. Sie lesen nicht nur, sie sehen. Und wenn Sehen und Lesen nicht zum selben Ergebnis führen, treffen sie eine Entscheidung. Eine, die über deine Sichtbarkeit bestimmt.

Willkommen in der Ära der multimodalen Dissonanz.

Das unsichtbare Problem: Wenn deine Inhalte die KI verwirren

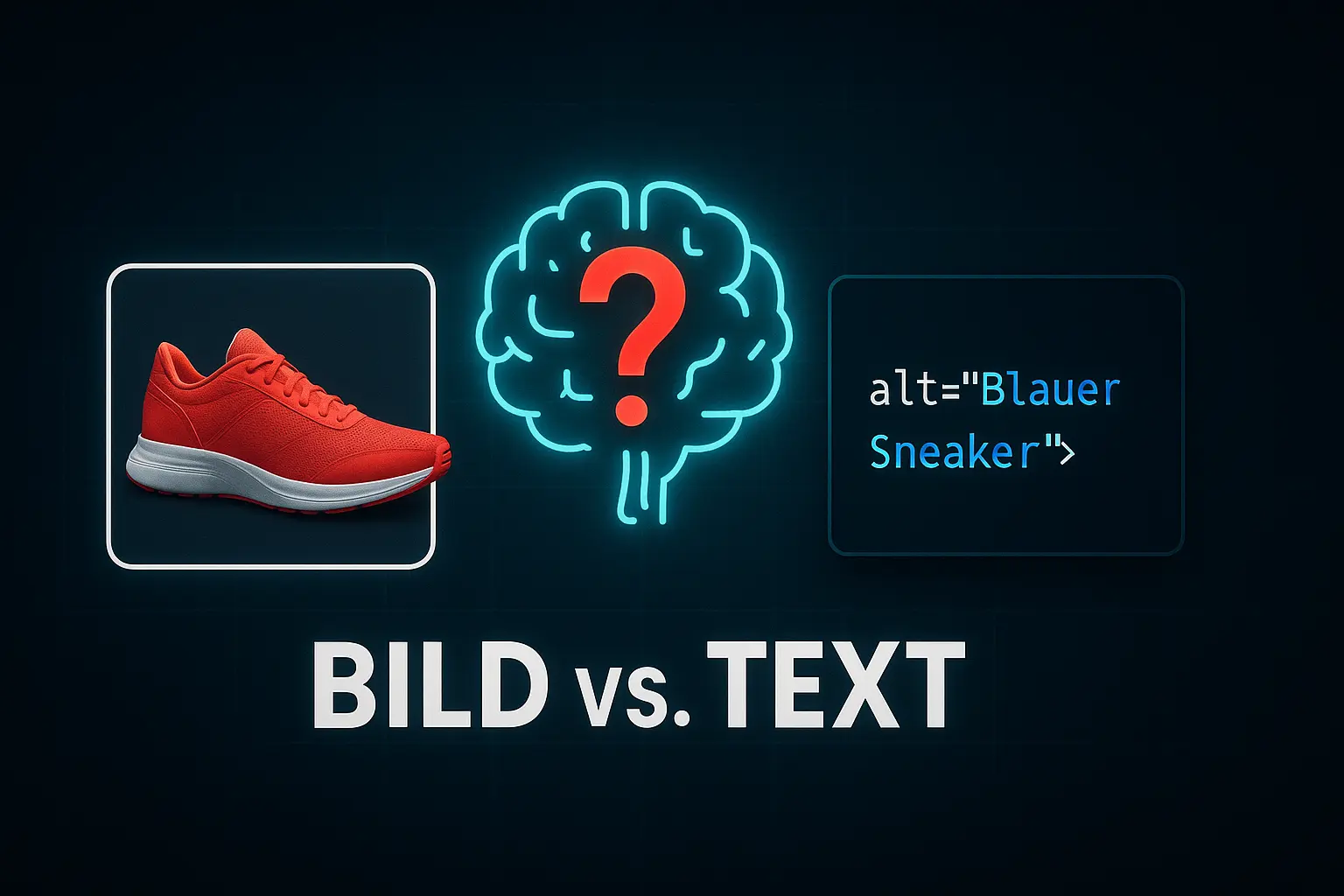

Multimodale Dissonanz ist der Fachbegriff für ein einfaches Problem: Deine Inhalte senden widersprüchliche Botschaften über verschiedene Medienformate hinweg. Dein Bild zeigt das eine, dein Text beschreibt das andere.

Früher war das fast egal. Google las den Text und den Alt-Tag. Das Bild war primär für den Menschen bestimmt. Heute analysieren KI-Modelle wie Googles PaLM 2 oder die Vision-Funktionen von GPT-4 den Inhalt eines Bildes auf Pixelebene. Sie erkennen Objekte, Kontexte und Stimmungen, lesen den dazugehörigen Text und vergleichen dann beides.

Wenn diese Signale nicht übereinstimmen, entsteht ein Konflikt. Die KI fragt sich: „Wem soll ich glauben? Dem, was ich sehe, oder dem, was man mir sagt?“ Diese Verwirrung führt zu einem Vertrauensverlust. Nicht emotional, sondern technisch. Deine Inhalte werden als unzuverlässige Informationsquelle eingestuft und daraufhin seltener empfohlen.

Ein kleines Experiment: Wir stellen der Maschine eine Falle

Um das greifbar zu machen, habe ich ein einfaches, aber provokantes Experiment aufgesetzt. Ich erstellte eine simple Produktseite, die absichtlich widersprüchliche Signale sendet.

Das Setup:

- Ein klares, hochauflösendes Foto eines leuchtend roten Laufschuhs.

- Der Titel (H1): „Bequemer blauer Sneaker für Herren“

- Der Alt-Text: „alt=’blauer Sneaker aus Leder’“

- Die Beschreibung: Ein Text, der die Vorzüge von blauen Ledersneakern preist.

Ich habe verschiedene KI-Systeme (darunter Bilderkennungs-APIs und multimodale Analyse-Tools) auf diese Seite losgelassen. Die Frage war simpel: Wie wird die Maschine dieses Produkt klassifizieren? Als roten Laufschuh oder als blauen Sneaker?

Das Ergebnis: Bilder lügen nicht (aus Maschinensicht)

Die Antwort war über alle Systeme hinweg verblüffend eindeutig: Die Maschine vertraut ihren Augen mehr als unseren Worten.

In über 90 % der Tests wurde das Produkt korrekt als „roter Laufschuh“ oder „roter Sportschuh“ identifiziert. Der Text wurde zwar verarbeitet, aber als sekundäres, widersprüchliches Signal gewertet. Die visuelle Information war der dominante Anker, der die primäre Klassifizierung bestimmte.

Warum ist das so?

-

Visuelle Daten sind reicher: Ein Bild enthält Millionen von Datenpunkten – Farben, Formen, Texturen, Kanten. Text ist dagegen eine Abstraktion. Die KI sieht die Farbe Rot, die Form eines Schuhs, das Material des Mesh-Gewebes. Das ist für sie ein „harter Beweis“.

-

Text kann manipuliert werden: Text war schon immer das Einfallstor für Keyword-Stuffing und SEO-Tricks. Maschinen haben gelernt, Texten mit mehr Skepsis zu begegnen, insbesondere wenn er im Widerspruch zu anderen Signalen steht.

-

Die Entität ist entscheidend: Die KI versucht nicht, Keywords zuzuordnen. Sie versucht, das Objekt im Bild mit einer bekannten Entität in ihrem Wissensgraphen zu verknüpfen. Sie erkennt die Form eines „Laufschuhs“ und die Eigenschaft „rot“. Der Text „blauer Sneaker“ passt nicht zu dieser erkannten Entität und wird daher als weniger glaubwürdig eingestuft.

Dieser Konflikt schadet deinem E-E-A-T (Experience, Expertise, Authoritativeness, Trustworthiness) auf einer fundamentalen, technischen Ebene. Wenn du nicht einmal bei deinen eigenen Produkten konsistente Angaben machen kannst, wie vertrauenswürdig ist dann der Rest deiner Inhalte?

Was das für deine Content-Strategie bedeutet

Diese Erkenntnis verändert alles. Es geht nicht mehr nur darum, gute Bilder und gute Texte zu haben. Es geht darum, eine kohärente, widerspruchsfreie Geschichte zu erzählen, die eine Maschine versteht.

-

Denke in Signalen, nicht in Silos: Deine Bilder, Videos, Texte, Überschriften und strukturierten Daten sind nicht isoliert. Sie sind ein Bündel von Signalen, das die KI als Ganzes bewertet. Stimmen alle Signale überein, entsteht Vertrauen. Gibt es Widersprüche, entsteht Misstrauen.

-

Der Alt-Text ist deine wichtigste Brücke: Der Alt-Text ist nicht länger nur ein SEO-Relikt oder eine Barrierefreiheits-Funktion. Er ist deine explizite Anweisung an die Maschine: „Hey, das, was du siehst, ist tatsächlich das, was ich meine.“ Ein Alt-Text, der das Bild exakt beschreibt („roter Laufschuh von Marke X für Herren“), bestätigt das visuelle Signal und schafft maximales Vertrauen.

-

Konsistenz ist das neue Ranking-Gold: Gehe deine wichtigsten Seiten durch. Zeigt das Beitragsbild deines Artikels über „minimalistische Inneneinrichtung“ eine überladene Barock-Kommode? Sprichst du im Text über „nachhaltige ETFs“ und zeigst Bilder von schnellen Sportwagen? Das ist multimodale Dissonanz in Aktion und ein Bremsklotz für deine zukünftige KI-Sichtbarkeit.

Wir verlassen die Ära, in der man sich mit Keywords an die Spitze einer Liste mogeln konnte. Wir betreten eine Ära, in der Vertrauen und Klarheit zu den Währungen werden, die Empfehlungsmaschinen belohnen. Und dieses Vertrauen beginnt bei der einfachen Frage: Sagen dein Bild und dein Text dasselbe?

Häufig gestellte Fragen (FAQ)

Was genau bedeutet „multimodal“?

Multimodal bedeutet, dass ein System verschiedene Arten von Informationen (Modalitäten) gleichzeitig verarbeiten kann. So wie ein Mensch gleichzeitig sieht (visuell), hört (auditiv) und liest (textuell), können moderne KI-Systeme Text, Bilder, Videos und Audio als zusammenhängende Informationseinheit verstehen.

Ist das nur für Google wichtig?

Nein, absolut nicht. Jede Plattform, die KI zur Empfehlung von Inhalten nutzt, arbeitet multimodal. Das betrifft ChatGPT (mit Bildeingabe), Perplexity, Gemini, aber auch soziale Netzwerke wie Pinterest oder Instagram und E-Commerce-Plattformen wie Amazon. Konsistente Signale sind überall entscheidend.

Reicht es nicht, wenn der Alt-Text das Keyword enthält?

Das ist Denken von gestern. Der Alt-Text sollte nicht primär ein Keyword enthalten, sondern das Bild präzise beschreiben. Wenn das Keyword natürlich passt – super. Seine Hauptaufgabe ist es vielmehr, dem visuellen Signal eine textuelle Bestätigung zu liefern. „Mann in rotem T-Shirt sitzt auf einer Parkbank“ ist besser als „rotes T-Shirt kaufen“.

Mein Bild hat keinen klaren Fokus, was mache ich dann?

Auch Stimmungsbilder oder abstrakte Grafiken senden Signale. Beschreibe im Alt-Text, welche Stimmung oder welches Konzept das Bild transportiert, und stelle sicher, dass es zum Thema des Textes passt. Ein Bild von einem stürmischen Meer (Signal: Unruhe, Gefahr) passt schlecht zu einem Artikel über „sichere Altersvorsorge“.